Now Reading: ซีอีโอ Anthropic เจ้าของ Claude เผย AI มีอาการ ‘หลอน (hallucination)’ น้อยกว่ามนุษย์ทั่วไปอีก !

-

01

ซีอีโอ Anthropic เจ้าของ Claude เผย AI มีอาการ ‘หลอน (hallucination)’ น้อยกว่ามนุษย์ทั่วไปอีก !

ซีอีโอ Anthropic เจ้าของ Claude เผย AI มีอาการ ‘หลอน (hallucination)’ น้อยกว่ามนุษย์ทั่วไปอีก !

ในอีเวนต์ Code with Claude ดาริโอ อโมเดอิ (Dario Amodei) ซีอีโอของ Anthropic สตาร์ตอัป AI ผู้พัฒนา Claude AI เผยว่า โมเดล AI ในปัจจุบันมีอาการ ‘หลอน (hallucination)’ หรือการสร้างข้อมูลที่ไม่เป็นความจริงขึ้นมาในอัตราที่น้อยกว่ามนุษย์เสียอีก !

ข้อคิดเห็นดังกล่าวเกิดขึ้นในระหว่างการพูดคุยถึงประเด็นสำคัญว่า อาการหลอนของ AI นั้นไม่ใช่ข้อจำกัดในการพัฒนา AGI หรือปัญญาประดิษฐ์ระดับมนุษย์ และอโมเดอิยังมองว่าการพัฒนา AGI อาจเกิดขึ้นได้เร็วที่สุดในปี 2026 โดยเขาได้เผยมุมมองเกี่ยวกับอาการหลอนว่า “มันขึ้นอยู่กับวิธีการทดสอบของคุณ แต่ผมสังเกตว่า AI โมเดลอาจหลอนน้อยกว่ามนุษย์ เพียงแต่ AI จะหลอนในมุมที่น่าประหลาดใจกว่า”

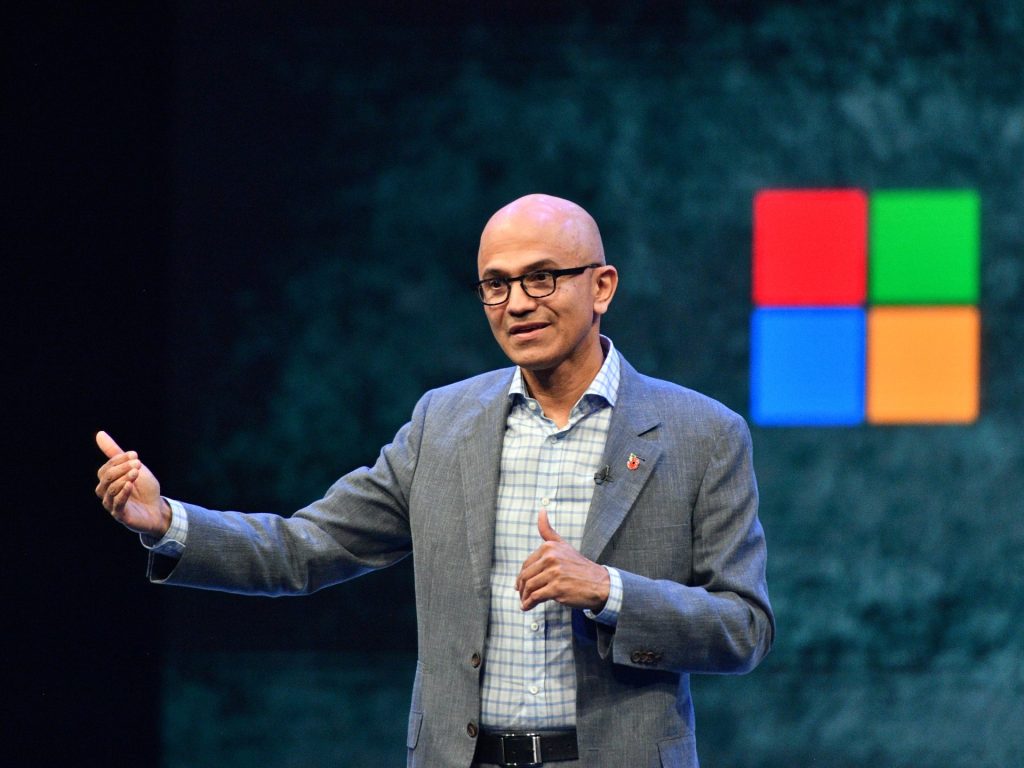

อย่างไรก็ตามหลายคนในอุตสาหกรรม AI ก็มีมุมมองที่ต่างออกไปจากอโมเดอิ เช่น ซีอีโอของ Google DeepMind ที่กล่าวว่า โมเดล AI ในปัจจุบันยังมีข้อบกพร่องมากเกินไป และยังตอบคำถามที่ชัดเจนผิดหลายข้อ ยกตัวอย่างเช่นข้อผิดพลาดที่ทนายความตัวแทนของ Anthropic ถูกสั่งให้ขอโทษในศาลหลังจากมีการใช้ Claude เพื่อสร้างหมายเรียกในเอกสารฟ้อง แต่เจ้าแชตบอตกลับเกิดอาการหลอนทำให้ระบุรายละเอียดชื่อและหัวข้อผิด

การพิสูจน์มุมมองของอโมเดอิอาจไม่ใช่สิ่งที่ทำได้ง่ายนัก เพราะการวัดอาการหลอนของโมเดล AI ในปัจจุบันมักเป็นการเปรียบเทียบกันเอง แต่จะไม่มีการเปรียบเทียบระหว่าง AI กับมนุษย์ แต่ในปัจจุบันบริษัทผู้พัฒนา AI ก็พยายามใช้เทคนิคต่าง ๆ เพื่อลดอาการหลอน เช่น การให้โมเดล AI เข้าถึงการค้นหาทางเว็บ อีกทั้งโมเดล AI เวอร์ชันใหม่ ๆ เช่น GPT-4.5 ก็มีอัตราการหลอนลดลงจากเวอร์ชันก่อนหน้าอย่างเห็นได้ชัด แม้ในบางโมเดล เช่น โมเดล o3 และ o4-mini ที่มีรายงานว่าอัตราการหลอนเพิ่มสูงขึ้น

ในช่วงหลังของอีเวนต์จาก Anthropic อโมเดอิยังได้ยกตัวอย่างว่า นักการเมือง นักข่าว และมนุษย์ในทุกสาขาอาชีพต่างก็ทำผิดพลาดอยู่ตลอดเวลา ดังนั้นการที่ AI จะมีข้อผิดพลาดก็ไม่ใช่เรื่องที่หักล้างความฉลาดของมันได้ แต่เขาก็ยอมรับว่า การนำเสนอข้อมูลที่ไม่เป็นความจริงของ AI นั้นเป็นปัญหา

ที่มา : Techcrunch