Now Reading: คนเริ่มใช้แชตบอต AI เป็นที่ปรึกษาทางใจ ผู้เชี่ยวชาญเตือนไม่ควรมาแทนนักบำบัด

-

01

คนเริ่มใช้แชตบอต AI เป็นที่ปรึกษาทางใจ ผู้เชี่ยวชาญเตือนไม่ควรมาแทนนักบำบัด

คนเริ่มใช้แชตบอต AI เป็นที่ปรึกษาทางใจ ผู้เชี่ยวชาญเตือนไม่ควรมาแทนนักบำบัด

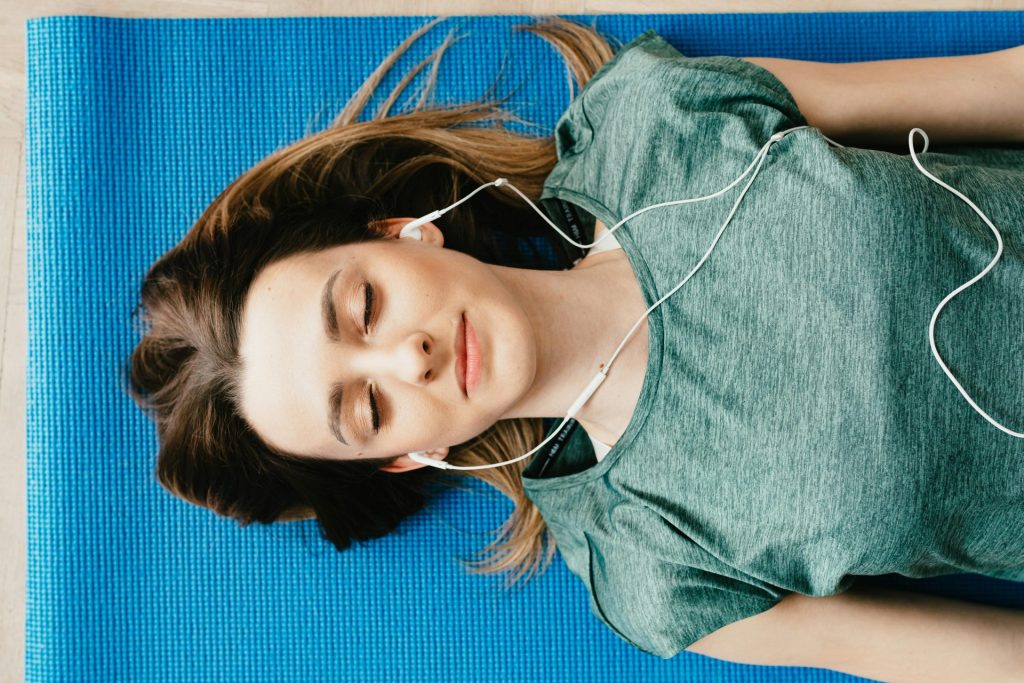

ตอนนี้คนจำนวนมากเริ่มรู้สึกโดดเดี่ยวมากขึ้น จนต้องหันไปใช้ แชตบอต AI เพื่อขอคำแนะนำและการสนับสนุนทางอารมณ์เพิ่มขึ้นทำให้ผู้เชี่ยวชาญด้านสุขภาพจิตเริ่มแสดงความกังวลเกี่ยวกับแนวโน้มที่เกิดขึ้น

เลียนนา ฟอร์ทูนาโต นักจิตวิทยาคลินิกและผู้อำนวยการด้านคุณภาพและนวัตกรรมการดูแลสุขภาพของสมาคมจิตวิทยาแห่งอเมริกา ระบุว่า การใช้ AI เพื่อการบำบัดหรือเป็นเพื่อนคุยกำลังกลายเป็นหัวข้อที่ถูกพูดถึงมากขึ้นในวงการผู้ให้บริการด้านสุขภาพจิต

งานวิจัยหลายชิ้นก็พบว่าผู้คนใช้เครื่องมือ AI เพื่อการสนับสนุนทางอารมณ์เพิ่มขึ้นอย่างต่อเนื่อง บางคนอาจเริ่มต้นเพียงแค่ระบายความเครียดในชีวิตประจำวันกับแชคบอตที่พร้อมรับฟัง บางคนใช้ AI เพื่อขอคำแนะนำด้านสุขภาพจิต เนื่องจากมีค่าใช้จ่ายต่ำกว่าการพบผู้เชี่ยวชาญ

ผลสำรวจด้านสุขภาพในกลุ่มผู้ใหญ่ชาวอเมริกันกว่า 20,000 คน โดยนักวิจัยจากสถาบันต่าง ๆ เช่น โรงพยาบาลแมสซาชูเซตส์เจเนอรัล เวลล์คอร์เนลล์เมดิซีน และมหาวิทยาลัยนอร์ทอีสเทิร์น พบว่า คน 10.3% ใช้ Gen AI เป็นประจำทุกวัน และในกลุ่มนี้ 87.1% ใช้เพื่อจุดประสงค์ส่วนตัว เช่น ขอคำแนะนำหรือการให้กำลังใจทางอารมณ์

บนแพลตฟอร์ม TikTok คำค้นหา “Therapy AI Bot” มียอดโพสต์มากกว่า 11.5 ล้านโพสต์ ตั้งแต่การแชร์วิธีใช้แชตบอตเป็นนักบำบัด ไปจนถึงคำเตือนจากผู้เชี่ยวชาญด้านสุขภาพเกี่ยวกับความเสี่ยงที่อาจเกิดขึ้น

แม้บริษัทเทคโนโลยีอย่าง Anthropic, Google และ OpenAI จะทุ่มงบประมาณมหาศาลในการพัฒนา AI และพยายามนำเครื่องมือเหล่านี้มาใช้ในชีวิตประจำวันมากขึ้น แต่ในอดีตแชตบอตบางแพลตฟอร์มยังไม่สามารถรับมือกับสถานการณ์วิกฤตทางสุขภาพจิตได้อย่างเหมาะสม

รายงานของ The New York Times เมื่อวันที่ 23 พฤศจิกายน ระบุว่าพบผู้ใช้เผชิญภาวะวิกฤตทางจิตใจระหว่างสนทนากับ ChatGPT ถึง 50 รายและมีผู้เสียชีวิตอย่างน้อย 3 ราย ซึ่งโฆษกของ OpenAI ระบุว่า บริษัทกำลังพัฒนาการฝึกฝนระบบอย่างต่อเนื่อง เพื่อให้ AI สามารถตรวจจับสัญญาณความทุกข์ใจ ลดความรุนแรงของบทสนทนา และแนะนำผู้ใช้ไปยังแหล่งช่วยเหลือในโลกจริง โดยทำงานร่วมกับแพทย์และผู้เชี่ยวชาญด้านสุขภาพจิต

งานวิจัยจาก OpenAI และ MIT Media Lab ในปี 2025 พบว่า การสนทนากับ AI บ่อยครั้งอาจส่งผลให้ทักษะทางสังคมลดลง และมีความสัมพันธ์กับระดับความเหงาที่เพิ่มขึ้น

สมาคมจิตวิทยาแห่งอเมริกาแนะนำว่า AI ไม่ควรถูกใช้แทนการบำบัดหรือการดูแลสุขภาพจิตจากผู้เชี่ยวชาญ แม้ผู้เชี่ยวชาญบางรายมองว่าแชตบอตสามารถใช้เป็นเครื่องมือเสริมได้ เช่น ช่วยตั้งคำถามสำหรับการเขียนบันทึกสะท้อนความคิด หรือค้นคว้างานวิจัยเกี่ยวกับวิธีรับมือกับปัญหาทางจิตใจ

เอซิน พินาร์ลี นักจิตบำบัดและโค้ชด้านไลฟ์สไตล์ ระบุว่า เธอมอง AI เป็นเพียง “เครื่องมือ” ที่อาจช่วยสนับสนุนกระบวนการเรียนรู้ด้านสุขภาพจิต แต่ไม่ใช่สิ่งที่จะมาแทนการบำบัดจริง

ผู้เชี่ยวชาญยังเตือนว่า ผู้ใช้ไม่ควรใช้ AI เพื่อ วินิจฉัยปัญหาสุขภาพจิต ขอความช่วยเหลือในภาวะวิกฤต หรือแบ่งปันข้อมูลสุขภาพส่วนตัว เนื่องจากการสนทนากับแชตบอตไม่ได้รับการคุ้มครองความลับทางการแพทย์ และ AI ยังไม่สามารถเข้าใจสัญญาณทางอารมณ์หรือภาษากายของมนุษย์ได้เหมือนผู้เชี่ยวชาญตัวจริงพร้อมเน้นย้ำว่าการสนับสนุนทางสุขภาพจิตที่มีประสิทธิภาพยังคงต้องอาศัยการสื่อสารกับมนุษย์จริง ที่สามารถรับรู้ทั้งน้ำเสียง อารมณ์ และภาษากายได้อย่างครบถ้วน

ที่มา cnbc