Now Reading: Meta, TikTok และ Snap เข้าร่วมประเมิน จัดอันดับความปลอดภัยออนไลน์ ปกป้องสุขภาพจิตแค่ไหน

-

01

Meta, TikTok และ Snap เข้าร่วมประเมิน จัดอันดับความปลอดภัยออนไลน์ ปกป้องสุขภาพจิตแค่ไหน

Meta, TikTok และ Snap เข้าร่วมประเมิน จัดอันดับความปลอดภัยออนไลน์ ปกป้องสุขภาพจิตแค่ไหน

แพลตฟอร์มโซเชียลมีเดียรายใหญ่ทั้ง Meta, YouTube, TikTok และ Snap ประกาศเข้าร่วมกระบวนการประเมินภายนอกรูปแบบใหม่ เพื่อให้คะแนนว่าแต่ละแพลตฟอร์มสามารถปกป้องสุขภาพจิตของผู้ใช้งานวัย 13–19 ปีได้ดีแค่ไหน

โครงการดังกล่าวเป็นส่วนหนึ่งของมาตรฐานความปลอดภัยออนไลน์ (Safe Online Standards: SOS) ภายใต้การดำเนินงานของ Mental Health Coalition โดยประกอบด้วยเกณฑ์ประเมินราว 24 ข้อ ครอบคลุมประเด็นสำคัญ เช่น นโยบายแพลตฟอร์ม การออกแบบฟังก์ชัน การกำกับดูแล ความโปร่งใส และระบบตรวจสอบเนื้อหา

Mental Health Coalition ระบุว่า SOS มีเป้าหมายสร้างข้อมูลที่ชัดเจนและอิงจากผู้ใช้ เกี่ยวกับวิธีที่แพลตฟอร์มดิจิทัลออกแบบผลิตภัณฑ์ ปกป้องผู้ใช้งานวัยรุ่น และจัดการกับเนื้อหาที่เกี่ยวข้องกับการทำร้ายตัวเองหรือการอัตวินิบาตกรรม ทางบริษัทที่สมัครใจเข้าร่วมจะต้องส่งเอกสารเกี่ยวกับนโยบาย เครื่องมือ และคุณสมบัติของผลิตภัณฑ์ เพื่อให้คณะผู้เชี่ยวชาญอิสระระดับโลกเป็นผู้ประเมิน

ภายหลังการประเมิน แพลตฟอร์มจะได้รับการจัดอันดับเป็น 3 ระดับ โดยระดับสูงสุดคือ “ใช้อย่างระมัดระวัง” ซึ่งมาพร้อมตราสัญลักษณ์สีฟ้าที่สามารถแสดงบนแพลตฟอร์มได้ แม้จะเป็นระดับสูงสุด แต่เกณฑ์ที่กำหนดมีลักษณะพื้นฐาน เช่น เครื่องมือรายงานที่เข้าถึงง่าย ฟังก์ชันความเป็นส่วนตัวที่ชัดเจน และตัวกรองที่ช่วยลดการเข้าถึงเนื้อหาที่ไม่เหมาะสม

ระดับรองลงมาคือ “การป้องกันบางส่วน” ซึ่งหมายถึงมีเครื่องมือด้านความปลอดภัยแต่ใช้งานยากหรือเข้าถึงได้จำกัด และระดับต่ำสุดคือ “ไม่เป็นไปตามมาตรฐาน” สำหรับแพลตฟอร์มที่ระบบกรองหรือควบคุมเนื้อหาไม่สามารถป้องกันเนื้อหาที่เป็นอันตรายได้อย่างมีประสิทธิภาพ

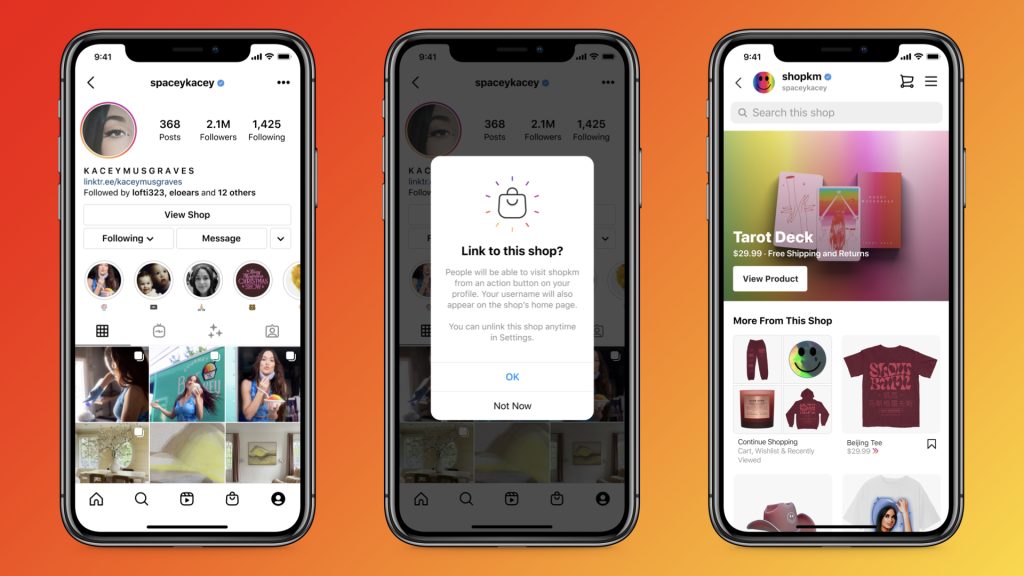

Mental Health Coalition ซึ่งก่อตั้งในปี 2020 เคยทำงานกับ Meta มาตั้งแต่ช่วงเริ่มต้น โดยในปี 2021 องค์กรได้ร่วมมือกับ Facebook และ Instagram เพื่อรณรงค์ลดการตีตราด้านสุขภาพจิตและเชื่อมโยงผู้คนกับแหล่งข้อมูลช่วยเหลือในช่วงการระบาดของโควิด-19 ต่อมาในปี 2022 องค์กรยังเผยแพร่กรณีศึกษา ซึ่งได้รับการสนับสนุนจาก Meta โดยระบุว่าเนื้อหาด้านสุขภาพจิตบนโซเชียลมีเดียสามารถช่วยลดการตีตราและส่งเสริมให้ผู้คนแสวงหาความช่วยเหลือได้

ในปี 2024 MHC ร่วมกับ Meta เปิดตัวแคมเปญ “Time Well Spent Challenge” สนับสนุนให้ผู้ปกครองพูดคุยกับวัยรุ่นเกี่ยวกับการใช้โซเชียลมีเดียอย่างเหมาะสม โดยเน้นการใช้งานอย่างคุ้มค่า เช่น ลดเวลาอยู่หน้าจอ ใช้แพลตฟอร์มในเชิงสร้างสรรค์ และตรวจสอบฟีดร่วมกันในครอบครัว นอกจากนั้นยังมีโครงการ “Thrive” ที่เปิดทางให้บริษัทเทคโนโลยีแบ่งปันข้อมูลเกี่ยวกับเนื้อหาที่ละเมิดหลักเกณฑ์ โดยเฉพาะเนื้อหาที่เกี่ยวข้องกับการทำร้ายตัวเอง ทั้งนี้ บนเว็บไซต์ขององค์กรระบุ Meta เป็น “พันธมิตรเชิงสร้างสรรค์”

ทาง Meta เคยเผชิญข้อกล่าวหาว่าปกปิดข้อมูลวิจัยภายในที่สะท้อนผลกระทบด้านลบของผลิตภัณฑ์ต่อสุขภาพจิตผู้ใช้ การศึกษา “โครงการเมอร์คิวรี” ซึ่งเริ่มในปี 2020 ถูกอ้างถึงในประเด็นดังกล่าว แม้บริษัทจะออกมาตรการบางประการ เช่น การพัฒนาบัญชี Instagram สำหรับวัยรุ่น ปัจจุบัน Meta กำลังเผชิญการดำเนินคดีในรัฐแคลิฟอร์เนียจากข้อกล่าวหาเกี่ยวกับผลกระทบต่อเด็กจากผลิตภัณฑ์ที่ถูกมองว่าส่งเสริมพฤติกรรมเสพติด

นอกจากแพลตฟอร์มข้างต้นแล้ว ยังมี Roblox ซึ่งถูกวิพากษ์วิจารณ์เกี่ยวกับประเด็นสวัสดิภาพเด็กบนแพลตฟอร์ม และ Discord ที่ได้เพิ่มความเข้มงวดในการตรวจสอบอายุผู้ใช้งาน มาเข้าร่วมในโครงการจัดอันดับนี้ด้วย

ที่มา engadget