Now Reading: YouTube ขยายฟีเจอร์ตรวจจับ Deepfake สู่กลุ่มนักการเมือง เจ้าหน้าที่รัฐ และสื่อ

-

01

YouTube ขยายฟีเจอร์ตรวจจับ Deepfake สู่กลุ่มนักการเมือง เจ้าหน้าที่รัฐ และสื่อ

YouTube ขยายฟีเจอร์ตรวจจับ Deepfake สู่กลุ่มนักการเมือง เจ้าหน้าที่รัฐ และสื่อ

หลังจากที่ YouTube ได้เปิดตัวฟีเจอร์ตรวจจับวิดีโอที่สร้างขึ้นจากเทคโนโลยี ‘Deepfake’ ที่สามารถเลียนแบบใบหน้า และเสียงของบุคคลดังหรือบุคคลอื่น ๆ มาใช้ในวิดีโอได้ จนเกิดเป็นปัญหาคอนเทนต์ปลอมสร้างควาเสียหายให้กับเจ้าของใบหน้าตัวจริงเหล่านั้น

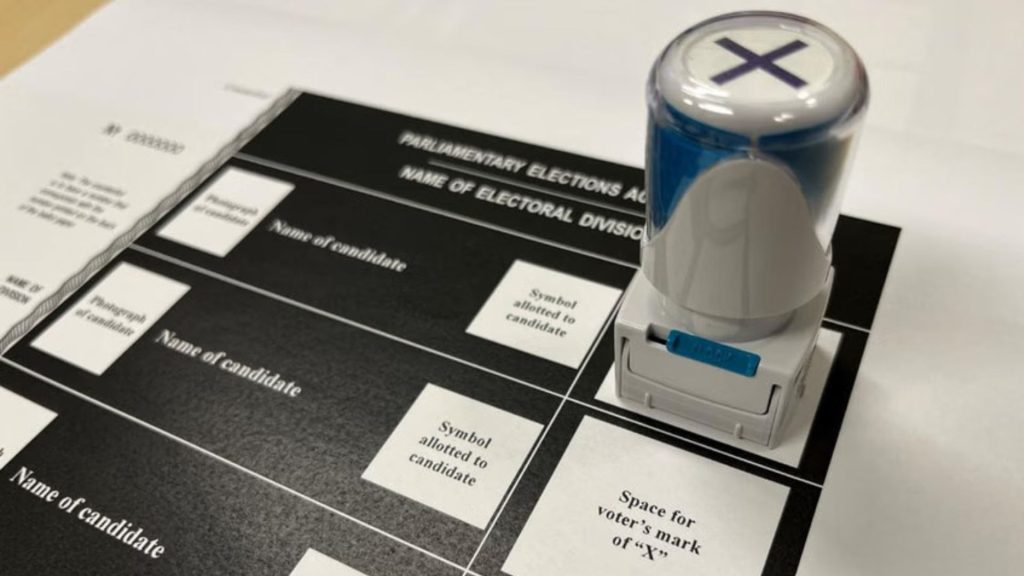

ล่าสุดแพลตฟอร์มได้ขยายฟีเจอร์ดังกล่าวอีกครั้ง โดยมุ่งไปยังกลุ่มเจ้าหน้าที่รัฐ ผู้สมัครทางการเมือง และนักข่าว เพื่อป้องกันการนำเทคโนโลยี Deepfake ไปใช้ปลอมแปลง จนทำให้ดูราวกับว่าพวกเขาเหล่านี้พูดหรือกระทำสิ่งที่ไม่เคยเกิดขึ้นจริง ซึ่งอาจสร้างแรงกระเพือมครั้งใหญ่ให้กับสังคมได้

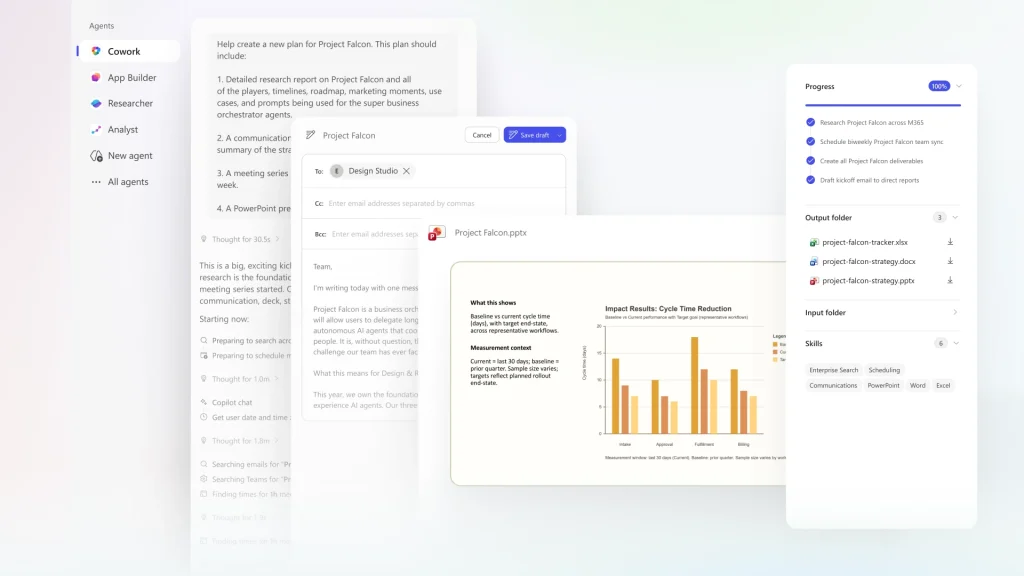

โดยมีหลักการทำงานคล้ายกับระบบ Content ID ของ YouTube ที่ใช้ตรวจจับเนื้อหาลิขสิทธิ์ ซึ่งระบบนี้จะทำหน้าที่ตรวจจับใบหน้าที่ถูกสร้างขึ้นด้วย AI ที่อาจถูกนำมาใช้เผยแพร่ข้อมูลเท็จ หรือบิดเบือนความจริงนั่นเอง

การขยายฟีเจอร์นี้มีเป้าหมายเพื่อรักษาความน่าเชื่อถือของบทสนทนาในที่สาธารณะ

เราทราบดีถึงความเสี่ยงจากการปลอมแปลงตัวตนด้วย AI ที่มีสูงมาก โดยเฉพาะกับบุคคลทางการเมือง

เลสลี มิลเลอร์ (Leslie Miller) รองประธานฝ่ายกิจการรัฐบาล และนโยบายสาธารณะของ YouTube กล่าว

อย่างไรก็ตาม ไม่ใช่ว่าทุกวิดีโอที่ได้รับการแจ้งเตือนจากฟีเจอร์ดังกล่าวจะถูกลบออกจากแพลตฟอร์ม เนื่องจาก YouTube จะพิจารณาเป็นรายกรณีว่าเนื้อหาเหล่านั้นเป็น “การล้อเลียน” หรือ “การวิจารณ์ทางการเมือง” หรือไม่ ซึ่งถือเป็นอีกรูปแบบหนึ่งของเสรีภาพในการแสดงออกที่ได้รับการคุ้มครอง

นอกจากนี้ YouTube ยังระบุเพิ่มเติมว่า กำลังสนับสนุนกฎหมายของรัฐบาลกลางสหรัฐฯ ที่ชื่อว่า ‘NO FAKES Act’ ซึ่งมีเป้าหมายเพื่อควบคุมการใช้ AI ในการสร้างเสียงหรือภาพลักษณ์เลียนแบบบุคคลโดยไม่ได้รับอนุญาต

ที่มา: Techcrunch