Now Reading: ดีล AI ระหว่าง Apple และ Google เป็นแค่การซื้อเวลาเพื่อพัฒนา Apple Intelligence เอง

-

01

ดีล AI ระหว่าง Apple และ Google เป็นแค่การซื้อเวลาเพื่อพัฒนา Apple Intelligence เอง

ดีล AI ระหว่าง Apple และ Google เป็นแค่การซื้อเวลาเพื่อพัฒนา Apple Intelligence เอง

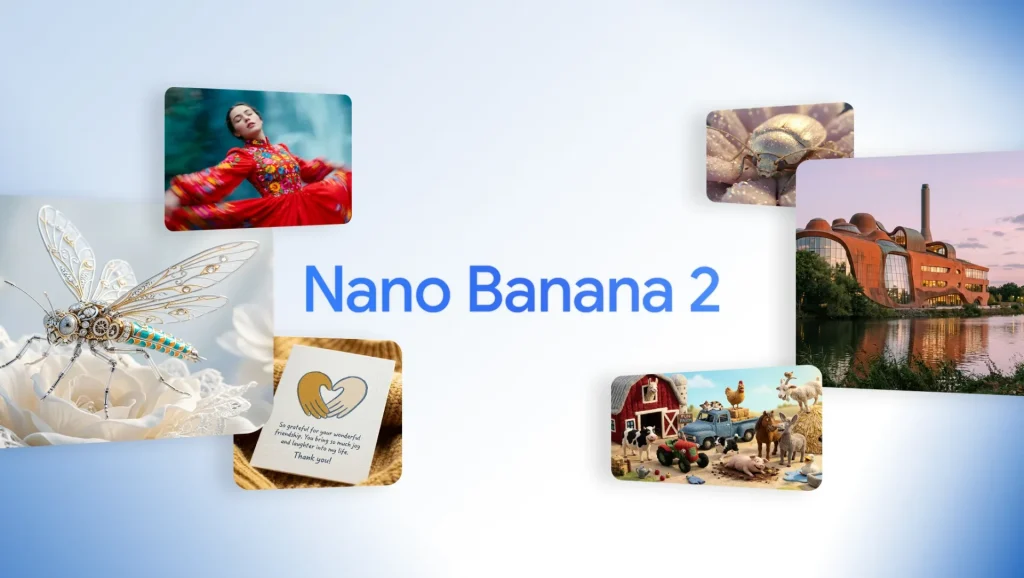

เป็นทางการแล้วว่า Apple จะใช้โมเดล AI ของ Google อย่าง Gemini มาขับเคลื่อน Siri เพื่อยกระดับความสามารถด้าน AI ให้มากขึ้น แต่นี่อาจเป็นเพียงการซื้อเวลาให้ Apple ได้พัฒนาของตัวเองเท่านั้น

กั๊ว หมิง จี (Ming Chi-Kuo) บอกว่า การที่ Apple เลือกจับมือกับ Google นั้นเป็นเพียงแผนระยะสั้นของบริษัทเท่านั้น เพื่อรองรับกระแสของ AI ที่แรงมากในปัจจุบัน แต่สำหรับกลยุทธ์ระยะยาว Apple ยังคงพัฒนา AI ของตัวเองต่อไป เพื่อควบคุมเทคโนโลยีด้วยตัวเอง ซึ่งเป็นสไตล์ของ Apple อยู่แล้ว

ปัจจุบัน Apple เจอตอ 2 อย่างในกลยุทธ์การพัฒนา AI ภายในองค์กร อย่างแรกคือการแสดงศักยภาพหรือความสามารถด้าน AI หลังจากประกาศฟีเจอร์ Siri ใหม่ แต่ยังไม่มีของจริงให้ใช้งาน อย่างที่ 2 คือ ความสามารถของ AI บนคลาวด์นั้นเกิดการพัฒนาที่รวดเร็วมาก ซึ่ง Apple เองก็ต้องไล่ตามให้ทันในส่วนนี้ด้วย กั๊วบอกว่า เมื่อผู้คนรับรู้หรือเข้าใจความสามารถของ AI ในปัจจุบัน ก็ทำให้ความคาดหวังในประสิทธิภาพของ AI นั้นสูงขึ้น ทำให้ Apple Intelligence เวอร์ชันเต็มตามที่ Apple บอกไว้ อาจไม่โดดเด่นมากพอด้วย

ด้วยเหตุผลนี้ ทำให้ Apple จำเป็นต้องเสริมความสามารถของ Apple Intelligence ด้วยการใช้โมเดล AI ของบริษัทอื่นไปก่อน ซึ่งการใช้งานโมเดล Gemini จะเป็นการแก้ปัญหาระยะสั้น ส่วนระยะยาว Apple ก็จะมีเวลาในการพัฒนาโมเดล AI ของตัวเองมากขึ้น โดยกั๊ว คาดว่า AI จะกลายเป็นหัวใจสำคัญของการสร้างความแตกต่างของฮาร์ดแวร์ การออกแบบระบบปฏิบัติการ และประสบการณ์การใช้งานโดยรวม ทำให้การเป็นเจ้าของเทคโนโลยี AI มีความสำคัญมากขึ้นเรื่อย ๆ

นอกจากนี้ กั๊วยังทิ้งท้ายว่า ชิปเซิร์ฟเวอร์ AI ที่พัฒนาโดย Apple คาดว่าจะเริ่มผลิตในช่วงครึ่งหลังของปี 2026 โดยศูนย์ข้อมูลที่ Apple ดำเนินการเองจะเริ่มใช้งานได้ในปี 2027 ซึ่ง Apple คาดว่าความต้องการใช้งาน AI บนอุปกรณ์และแบบไฮบริดจะเติบโตอย่างมีนัยสำคัญมากขึ้นตั้งแต่ปี 2027 เป็นต้นไป เนื่องจาก Apple จะสามารถควบคุมการประมวลผลฝั่งเซิร์ฟเวอร์และโครงสร้างพื้นฐานได้มากขึ้น

ที่มา MacRumors