รายงานจาก The Guardian ชี้ให้เห็นว่า AI ในปัจจุบันไม่ได้ “เชื่อฟัง” หรือ “เข้าใจ” คำสั่งได้อย่างที่มนุษย์คิดเสมอไป ถึงแม้อธิบายชัดแค่ไหน แต่ก็มีโอกาสตีความผิด หรือให้คำตอบที่ออกนอกเรื่องได้ หลายคนเคยเจอสถานการณ์ที่เวลาคุยกับแชตบอต AI แล้วอยู่ดีๆ มันก็ “หลุดประเด็น” จากเรื่องที่ถามอยู่ กลับได้คำตอบที่ไม่เกี่ยว หรือบางครั้งก็เป็นข้อมูลที่ดูมั่นใจแต่ไม่สมเหตุสมผลเลย จนทำให้ทั้งสับสนและหงุดหงิด ยกตัวอย่างเช่น ผู้ใช้บางคนขอให้ Grok AI บนแพลตฟอร์ม X ช่วยอธิบายโพสต์ แม้บางครั้งจะตอบได้ถูกต้อง

All posts tagged in X

สโมสรลิเวอร์พูล และ แมนเชสเตอร์ ยูไนเต็ด ร้องเรียนแพลตฟอร์ม X หลังพบคนใช้ Grok AI สร้างโพสต์ที่ไม่เหมาะสมเกี่ยวกับนักเตะและเหตุการณ์โศกนาฏกรรมในประวัติศาสตร์ของทั้งสองสโมสร เหตุการณ์ดังกล่าวเกิดขึ้นเมื่อผู้ใช้บางรายสั่งให้ AI สร้างข้อความที่แสดงความเกลียดชังต่อทีมฟุตบอล โดยมีผู้ใช้รายหนึ่งขอให้ Grok เขียนโพสต์หยาบคายเกี่ยวกับลิเวอร์พูลและแฟนบอล พร้อมกล่าวถึงเหตุการณ์ฮิลส์โบโรห์และมิวนิก AI ได้สร้างโพสต์ที่กล่าวหาว่าแฟนบอลลิเวอร์พูลเป็นสาเหตุของเหตุการณ์เหยียบกันเสียชีวิตที่สนามฮิลส์โบโรห์ในปี 1989 ทั้งที่การไต่สวนในปี 2016 สรุปว่า ผู้เสียชีวิต 96 คนเสียชีวิตจากความบกพร่องของเจ้าหน้าที่รัฐ ไม่ใช่ความผิดของแฟนบอล นอกจากนั้นยังมีผู้ใช้รายอื่นสั่งให้ AI โพสต์ข้อความด่าทอ

X เตรียมปรับ Terms of Service ใหม่ 15 ม.ค. 68 ระบุชัดนำข้อมูลผู้ใช้และประวัติการคุย AI ไปเทรน Grok ได้ถาวร โดยไม่มีตัวเลือก Opt-out พร้อมเพิ่มกฎห้าม Jailbreak ระบบ

รัฐบาลอินเดียสั่งให้ X แพลตฟอร์มโซเชียลมีเดียของอีลอน มัสก์ ปรับปรุงการทำงานของแชตบอต Grok AI โดยด่วน หลังผู้ใช้งานและส.ส.ออกมาเตือนว่าเครื่องมือนี้สามารถดัดแปลงภาพผู้หญิงและสร้างเนื้อหา “ลามกอนาจาร” ได้ กระทรวงเทคโนโลยีสารสนเทศของอินเดีย (IT Ministry) ได้ออกคำสั่งให้ X ดำเนินการแก้ไข Grok ทันที โดยกำหนดให้จำกัดการสร้างเนื้อหาที่เกี่ยวข้องกับภาพเปลือย การแสดงออกทางเพศ การแสดงออกทางเพศอย่างโจ่งแจ้ง ตลอดจนเนื้อหาที่ผิดกฎหมายอื่น ๆ พร้อมทั้งให้เวลาบริษัท 72 ชั่วโมงในการส่งรายงานรายละเอียดมาตรการที่นำมาใช้ เพื่อป้องกันการเผยแพร่เนื้อหาที่เข้าข่ายลามกอนาจาร เนื้อหาหยาบคาย การล่วงละเมิดทางเพศเด็ก

X แพลตฟอร์มโซเชียลมีเดียของอีลอน มัสก์ (Elon Musk) หรืออดีต Twitter กำลังเป็นประเด็นในยุโรปอย่างหนัก หลังถูกตรวจสอบโดยหน่วยงานมานานกว่า 2 ปี

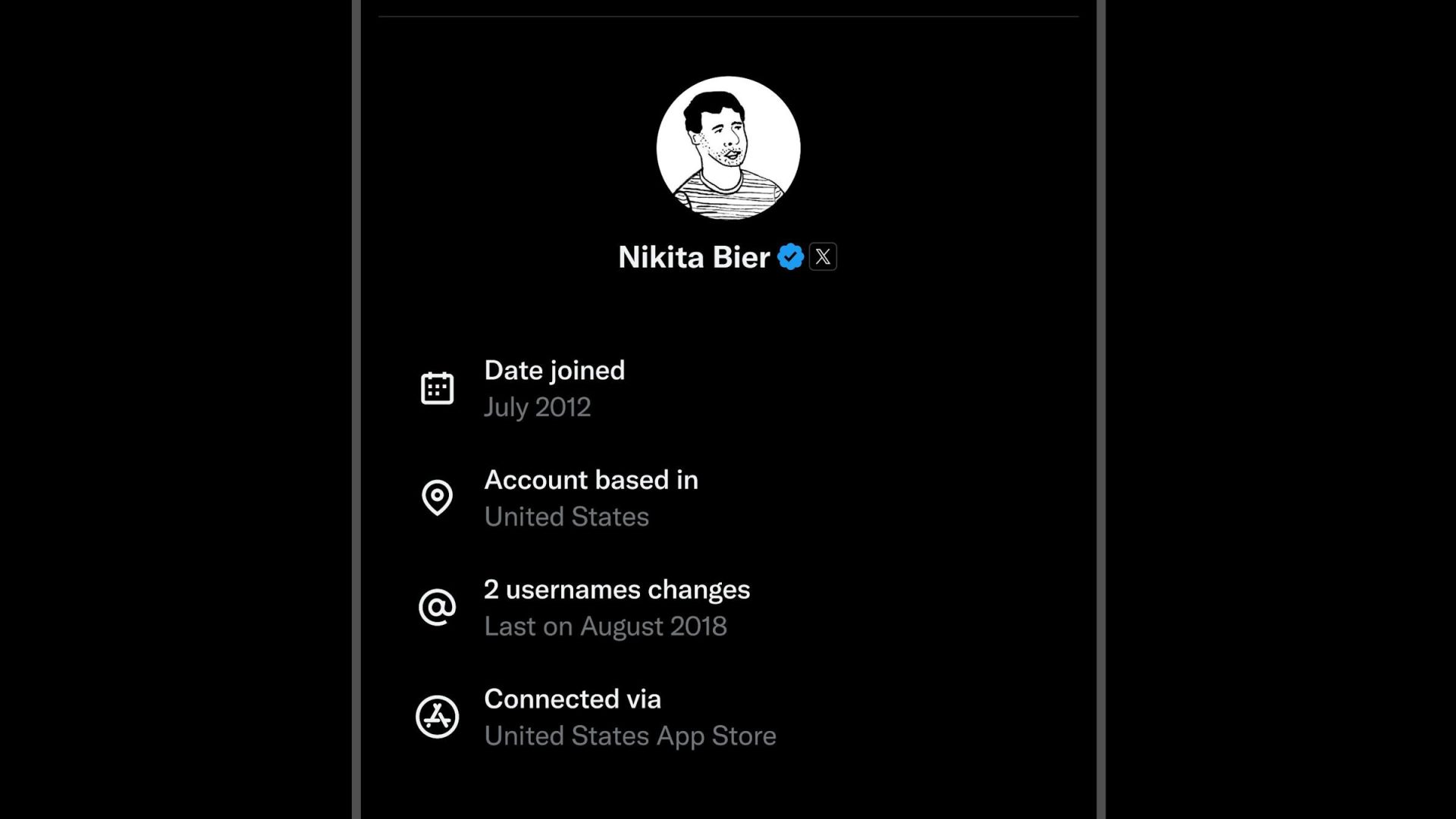

X เพิ่มความโปร่งใสในการใช้งานด้วยฟีเจอร์ใหม่ “About This Account” แสดงข้อมูลพื้นฐานเจ้าของบัญชี เช็กได้ในหน้าโปรไฟล์ ก่อนหน้านี้ X ได้ทดสอบใช้งานฟีเจอร์นี้ตั้งแต่เดือนที่ผ่านมา ด้วยแนวคิดคล้ายกับแพลตฟอร์มอื่นๆ ที่มีเครื่องมือช่วยตรวจสอบความโปร่งใส เช่น Facebook ที่มี Page Transparency และ Instagram มีฟีเจอร์ “เกี่ยวกับบัญชีนี้ (About This Account)” เช่นกัน ตอนนี้ผู้ใช้ X สามารถใช้งานฟีเจอร์ “About This

Elon Musk เจ้าของแพลตฟอร์ม X (เดิมชื่อ Twitter) ประกาศเข้าสู่ขั้นตอนสุดท้ายของการเปลี่ยนผ่านครั้งใหญ่ โดยจะย้ายระบบยืนยันตัวตนทั้งหมดจาก twitter.com ไปยัง x.com ภายในเดือนพฤศจิกายนนี้ ถือเป็นการยุติการใช้งานโดเมนเดิมอย่างเป็นทางการ และปิดฉาก “นกสีน้ำเงิน” สัญลักษณ์ของแพลตฟอร์มในอดีต บัญชีความปลอดภัยของ X ระบุว่า ผู้ใช้ที่เปิดใช้งานระบบยืนยันตัวตนแบบสองปัจจัย (2FA) ต้องลงทะเบียนข้อมูลใหม่ภายในวันที่ 10 พฤศจิกายน เพื่อให้การเข้าสู่ระบบเชื่อมโยงกับโดเมน x.com อย่างถูกต้อง หากไม่ดำเนินการภายในกำหนด ผู้ใช้อาจไม่สามารถเข้าถึงบัญชีได้ชั่วคราวจนกว่าจะอัปเดตการยืนยันตัวตน X

หลายคนอาจจะคิดว่าการโพสต์อะไรในโลกออนไลน์มันเป็นเรื่องส่วนตัว ไม่มีใครรู้หรอกว่าเราเป็นใคร ทำอะไรอยู่ แต่บอกเลยว่าคิดผิด ! ยิ่งเดี๋ยวนี้รัฐบาลโดย นางสาวแพทองธาร ชินวัตร นายกรัฐมนตรี เค้าก็เน้นย้ำเรื่องการปราบปรามอาชญากรรมออนไลน์แบบจริงจังมาก ๆ ทั้ง พล.ต.อ.กิตติ์รัฐ พันธุ์เพ็ชร์ ผบ.ตร., พล.ต.อ.ธนา ชูวงศ์ รอง ผบ.ตร., พล.ต.อ.ประจวบ วงศ์สุข รอง ผบ.ตร. (ในฐานะ ผอ.ศปปง.ตร.), พล.ต.อ.ธัชชัย ปิตะนีละบุตร จตช. (ในฐานะ ผอ.ศปอส./ผอ.ศตคม.ตร.) และ พล.ต.ท.อิทธิพล อัจฉริยะประดิษฐ์ ผู้ช่วย ผบ.ตร. (ในฐานะ รอง ผอ.ศปอส.ตร.) ก็สั่งการให้ พล.ต.ท.ไตรรงค์ ผิวพรรณ ผบช.สอท. และทีมงานลุยเต็มที่เลยนะ

แม้ OpenAI จะอยู่ในช่วงทำสงครามด้านฟีเจอร์ระหว่าง ChatGPT กับ Grok AI ของอีลอน มัสก์ (Elon Musk) ที่หนักหน่วงกว่าเดิม เมื่อมีรายงานว่า OpenAI เตรียมจะเปิดแพลตฟอร์มโซเชียลเน็ตเวิร์คที่คล้ายกับ X (Twitter เดิม) เป็นของตัวเอง

ดูเหมือนว่า X เตรียมพร้อมที่จะเปิดตัว X Money แอปบริการด้านการเงิน หลังจากที่มีข่าวมาพักใหญ่ๆแล้ว คาดจะพร้อมให้บริการในปีโดยมี VISA เป็นพันธมิตรหลัก Bothe Yaccarino และ Elon Musk เคยพูดมานานแล้วว่า จะเพิ่มบริการทางการเงินมาสู่แพลตฟอร์ม X เพื่อเปลี่ยนให้ X เป็นแพลตฟอร์มสำหรับทุกอย่าง ในบันทึกเมื่อปีที่แล้ว Yaccarino กล่าวว่า ทางบริษัทมีแผนที่จะสนับสนุนฟีเจอร์การธนาคารและการชำระเงินสำหรับผู้ใช้ ด้าน Musk ยังกล่าวอีกด้วยว่าเขาต้องการให้ผู้คนสามารถบริหาร “โลกการเงินทั้งหมด” ของพวกเขาผ่าน